Introduction

Decision Trace Model(DTM)の話をすると、

「そこまでリッチな設計は現場ではできない」

という声をよく聞きます。

私はその場面で、

「DTMはもっと軽く始められます」

と答えています。

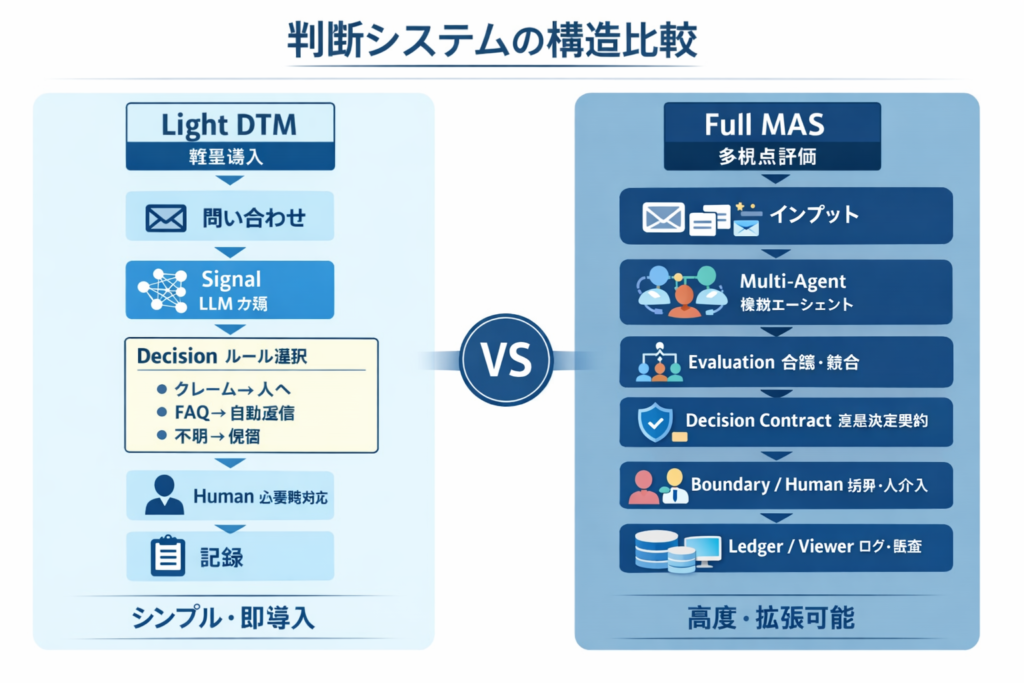

DTMは、最初からフル構成(Ontology / Multi-Agent / Behavior Treeなど)を前提とするものではありません。

実際には、

最小構成(Light DTM)から始めて、段階的に拡張できる

という特徴を持っています。

本記事では、このLight DTMを用いて、

問い合わせ対応におけるAI導入の改善について述べます。

現在、多くの企業で行われている問い合わせ対応のAI導入は、主に次のようなものです。

・LLMによる自動分類

・FAQの自動回答

・チャットボットによる一次対応

一見すると、AIはすでに「問い合わせ対応を自動化できている」ように見えます。

しかし実際の現場では、次のような問題が発生しています。

・誤分類が発生する

・クレームや重要案件を見逃す

・対応が担当者ごとにばらつく

・「なぜその判断になったのか」が分からない

これらは個別の問題に見えますが、

実は共通の原因があります。

つまり、

AIは出力しているだけで、判断していない

という構造的な問題です。

Signal ≠ Decision

ここで重要なポイントがあります。

機械学習やLLMが出しているものは「意思決定」ではありません。

例えば:

- 「これはクレームです」

- 「解約意図があります」

- 「不満度が高いです」

これらはすべて、

Signal(信号)

です。

しかし現実には、次のような判断が必要になります。

- クレーム → 人に回すのか?そのまま対応するのか?

- 解約希望 → 止めるのか?受け入れるのか?

- 不正の可能性 → エスカレーションするのか?

ここが Decision(意思決定)

です。

つまり、

Signal → Decision の間にギャップがある

Light Decision Trace Model(最小構成)

このギャップを、最小限の構造で埋めるのが

Light Decision Trace Model です。

構成は非常にシンプルです。

Event:問い合わせ → Signal:LLM分類 → Decision: ・クレーム → 人に回す ・FAQ → 自動返信 ・不明 → 保留 → Human:必要時対応 → Log:記録

Light DTMでは、

・モデル自体はそのまま使う

・新しいAIを作る必要はない

・既存の処理に「判断のルール」を追加するだけ

つまり、

大きな作り替えをせずに導入できる

という意味で「軽い」のです。

なぜ「軽いのに効く」のか

では、なぜそれだけで効果が出るのでしょうか。

それは、

これまで曖昧だった「判断」を構造として切り出しているからです

従来は、

Signal(分類・スコア・生成結果)=そのまま処理

となっており、

・なぜその対応になったのか分からない

・人によって判断が変わる

・改善ができない

という状態になっていました。

Light DTMでは、

Signal(出力)

→ Decision(判断ルール)

を明確に分離します。

これにより、

・判断基準が明示される

・同じ条件なら同じ判断になる

・ルールとして改善・更新できる

ようになります。

つまり、

「出力するAI」から「判断できるシステム」へ

構造が変わるのです。

Light DTMの横展開

このLight DTMの構造は、問い合わせ対応に限りません。

むしろ重要なのは、

「Signal → Decision → Human → Log」という最小構造が、そのまま他業務にも適用できること

です。

特別なAIや複雑な仕組みを新たに作る必要はなく、

既存のデータ・既存のモデルに「判断構造」を追加するだけで展開できる

というのがポイントです。

以下に他の領域に展開した例を示します。

① 不正検知(Fraud Check)

Signal:リスクスコア / 異常検知

Decision:止める / 通す / 人へ

従来は、

・閾値頼みで誤検知が多い

・見逃しとのトレードオフが調整できない

という問題があります。

Light DTMでは、

判断ルールと人へのエスカレーションを明示的に設計

することで、

・誤検知と見逃しのバランスを調整可能にする

・「なぜ止めたか / 通したか」を説明可能にする

金融・ECにおける意思決定の安定性が向上します。

② 承認フロー(社内稟議)

Signal:LLMによる要約・評価 / スコア

Decision:承認 / 差し戻し / エスカレーション

従来は、

・担当者ごとに判断基準が異なる

・過去の判断が再利用できない

という問題があります。

Light DTMでは、

判断基準を構造として外出しする

ことで、

・誰が見ても同じ判断になる

・判断履歴を資産として蓄積できる

属人的な判断から、再現可能な意思決定へ

変わります。

③ 店舗判断(値引き・対応)

Signal:顧客情報 / 購買履歴 / LLM提案

Decision:値引きするか / 提案するか / 保留

従来は、

・現場判断に依存する

・経験や勘に頼る部分が大きい

という課題があります。

Light DTMでは、

現場判断をDecisionとして構造化し、ログとして蓄積

することで、

・判断のばらつきを抑える

・成功パターンを再利用できる

現場の意思決定を企業の資産に変える

ことが可能になります。

共通していること

これらすべてに共通しているのは、

AIの精度を上げることではなく、判断の構造を作ること

です。

そしてそれは、

Light DTMの最小構成からでも十分に実現できる

という点が重要になります。

高度な機能への拡張:Multi-Agentへ

この構成は、より高度な構成へ自然に拡張することができます。

最初はシンプルな

Signal → Decision

の構造でも十分に機能しますが、現実の意思決定は通常、単一の基準ではなく、複数の観点のバランスによって行われます。

例えば:

・リスク視点(Risk Agent)

→ 不正・障害・クレームの可能性はないか

・顧客体験(UX Agent)

→ 顧客満足を損なわないか

・収益影響(Business Agent)

→ コスト・売上への影響はどうか

これらを1つのモデルやルールに押し込むのではなく、

役割ごとに分離する

ことで、

それぞれが独立した Signal を生成する構造になります。

その結果、

Signal(Risk)

Signal(UX)

Signal(Business)

→ Decision(統合判断)

という形になり、

複数の視点を明示的に扱った意思決定

が可能になります。

このアプローチの重要なポイントは、

・判断の根拠が分解される

・どの観点が影響したかが分かる

・後から重みやルールを調整できる

という点です。

つまり、

ブラックボックスな判断から、調整可能な判断へ

変わります。

これが、

Multi-Agentによる分散判断

です。

単にエージェントを増やすことが目的ではなく、

意思決定を「視点ごとに分解する」ための構造

であることが重要です。

この構造も”Decision Systemの実行レイヤー — Multi-Agent Orchestrator Coreで何ができるのか“でのべているMulti-Agent Orchestrator CoreでLight DTMと共に実現することができます。

■ 結論

AIはすでに「出力」はできるようになりました。

しかし現場で必要なのは、

何をするかを決めること

です。

Light Decision Trace Modelは、

最小構成で「判断」を導入する方法

です。

同じ仕組みでも、「どこまで構造化するか」で大きく変わる

重要なのは、最初からFullを作ることではない

Lightから始めて、必要に応じて拡張できること

そしてそこから、

Multi-Agentによる高度な意思決定へ

自然に拡張することです。

AIシステム設計・意思決定構造の設計を専門としています。

Ontology・DSL・Behavior Treeによる判断の外部化、マルチエージェント構築に取り組んでいます。

Specialized in AI system design and decision-making architecture.

Focused on externalizing decision logic using Ontology, DSL, and Behavior Trees, and building multi-agent systems.