AIはなぜ現場で止まるのか

POCは成功する。

しかし、AIは現場で止まります。

現場で実際に起きていることは、次のようなものです。

POCは成功する

精度も出る

デモも問題なく動作する

しかし、

本番環境では使われない

いつの間にか運用が止まってしまう

最終的に、誰も責任を持たない状態になる

では、なぜこのようなことが起きるのでしょうか。

よく見られる失敗パターンは、以下の通りです。

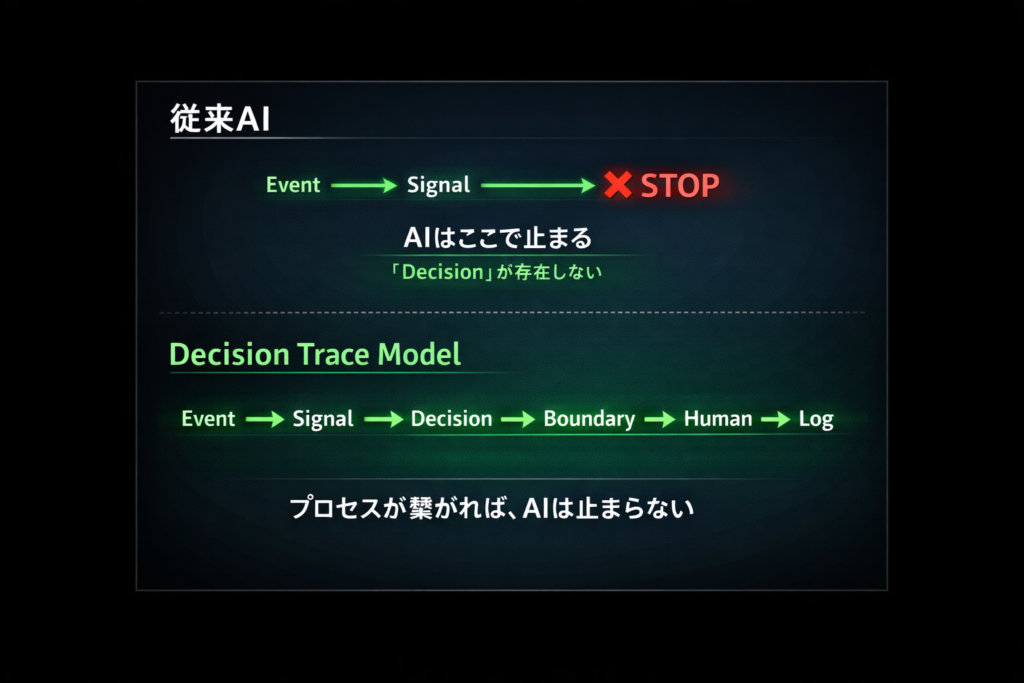

AIは予測するだけにとどまっている

予測結果は出るものの、

その結果をもとに「どうするのか」が定義されていません。

つまり、

Signal(AIの予測結果)で処理が止まってしまっている状態です。

判断がブラックボックス化している

なぜその結果になったのかが分からず、

判断の根拠を説明することができません。

そのため、

なぜその判断なのか説明できない

責任を持つことができない

結果として、現場では使われなくなる

という状況が生まれます。

責任の所在が曖昧になっている

AIが提示した結果なのか、

人が最終的に判断したのかが不明確になり、

結果として、

責任の所在が曖昧になります。

システムとして業務に組み込めない

業務フローと適切に接続されておらず、

実際の運用に落とし込むことができません。

これは、

意思決定として定義されていないため、

実行可能なプロセスとして設計されていないことに起因します。

その結果、

システムとして活用されることなく、使われなくなってしまいます。

課題の本質

これはAIの問題ではありません。

本質的には、判断の構造が存在していないことにあります。

AIが行う意思決定は、本来次のような流れで行われます。

Event → Signal → Decision → Boundary → Human → Log

Event(出来事)

→ Signal(予測)

→ Decision(判断)

→ Boundary(制約)

→ Human(人)

→ Log(記録)

※簡単にご説明すると:

- Event:何が起きたか(例:ユーザーが商品を閲覧した)

- Signal:AIが出した予測(例:購入確率 70%)

- Decision:どのように対応するか(例:割引を提示するか)

という構造になります。

判断の構造の不在 – 同じAIでも、結果が変わる

AIは予測や分類はできます。

しかし現場で必要なのは、

その結果を受けて「どうするか」を決めることです。

どの条件で実行するのか

何を優先するのか

どこで止めるのか

いつ人に戻すのか

こうした判断が定義されていなければ、

AIの出力は Signal のままで止まり、

実際の業務にはつながりません。

さらに重要なのは、

この判断はドメインごとに異なるということです。

例えば、

- 製造業では、安全性・停止回避・品質

- 金融では、リスク・規制・説明責任

- 医療では、緊急度・安全性・倫理性

- 小売では、売上・顧客体験・機会損失

が優先されます。

したがって、

同じ Signal が出ても、その後の Decision は変わります。

つまり、AIが止まる理由の一つは、

判断の優先順位という見えない設計が定義されていないこと にあります

→ 関連記事:

同じAIでも結果が変わる理由 — 「判断の優先順位」という見えない設計

さらに理解する

構造の再定義

- Decision Systemとは何か?— AIを「予測」から「意思決定システム」へ

- 構造が世界を変える — 情報を「扱える形」にするということ

- 構造が文化を生む — バウハウスからAI時代の設計へ

データがない世界の意思決定

AIが止まる理由をさらに深掘りする

関連記事を見る

数学的観点からみたAI

AIの限界と不連続性

- なめらかな計算では、判断は表現できない ──AIと不連続性の問題

- なめらかに世界を計算するための数 e と π

- AIは「決めない」ことで賢くなる ―勾配・確率・保留という態度と、決断を急がない設計

- 確率は不確実性を減らすためのものではない ―確率の本当の役割と、「曖昧さを保持する設計」という視点

- 「連続近似のAI」と「意味の断絶」の中間にある技術GNN — AIは意味に近づけるのか —

判断・責任・人間の役割

- 人間はどこに残るのか──Human-in-the-loop の再定義

- Human-in-the-loop が機能しない本当の理由 ―なぜ「最後に人間」は責任を失うのか、Human-as-Author への転換

- AIはなぜ「責任」を持てないのか ――判断と責任が分離できない理由と、ロジック外在化の必然性

- 評価関数は誰の価値観か? ―スコアに埋め込まれる暗黙の判断と、人間が「書かなかった価値」の扱い

最適化・評価・暴走の問題

- 最適化が暴走するとき、何が起きているのか ―目的関数が世界を歪める瞬間と、Goodhartの法則を設計でどう扱うか

- なぜ「説明可能AI」は本質的な説明にならないのか ―Explanation と Justification の違いと、ロジックと説明責任の分業

- 例外は失敗ではない ―例外処理をどう設計に組み込むか、例外が多いほど健全なシステムという視点

常識・信用・社会実装

AIを“産業”として捉え直す視点

- AI工場モデル(AI Factory) ― AIはソフトウェアではなく「製造業」になる ―

- AI品質工学(AI Quality Engineering) — 品質工学が、なぜAIの時代に再び重要になるのか —

Decision Trace Model

Architecture

Use Case