AIはなぜ現場で止まるのか

POCは成功する。

しかし、AIは現場で止まる。

現場で起きていること

POCは成功する

精度も出る

デモも動く

しかし、

本番で使われない

いつの間にか止まる

誰も責任を持たない

よくある失敗パターン

1. AIは予測するだけ

- 予測は出る

- でも「どうするか」がない

Signal (AIの予測結果) 止まり

2. 判断がブラックボックス

- なぜその結果なのか分からない

なぜその判断なのか説明できない

責任が持てない

だから現場は使わない

3. 責任の所在がない

- AIが言った

- 人が判断した

責任が曖昧

4. システムに組み込めない

- 業務フローと繋がらない

意思決定として定義されていないため、

実行に落とせない

だから使われない

本質

AIの問題ではない

判断の構造が存在していない

意思決定は本来、次の流れで行われる

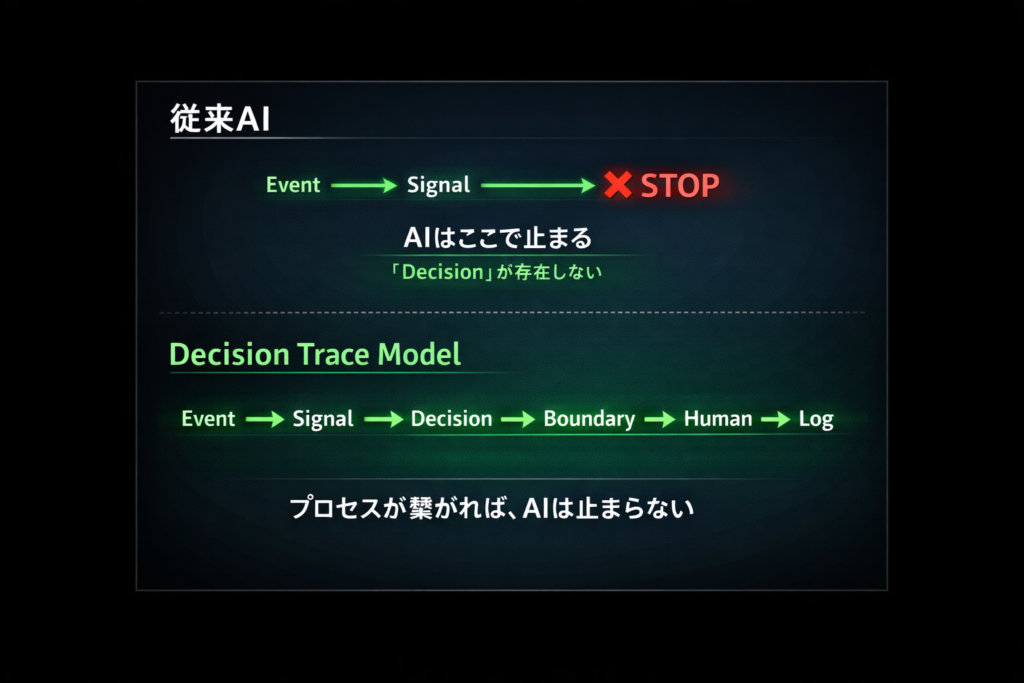

Event → Signal → Decision → Boundary → Human → Log

Event(出来事)

→ Signal(予測)

→ Decision(判断)

→ Boundary(制約)

→ Human(人)

→ Log(記録)

※簡単にいうと:

Event:何が起きたか(例:ユーザーが商品を見た)

Signal:AIが出した予測(例:購入確率 70%)

Decision:どうするか(例:割引を出すか)

である。

AIはDecisionが存在しないため止まる。

結論

AIは予測エンジンではない

意思決定システムであるべきである。

さらに理解する

AIが止まる理由をさらに深掘りする

関連記事を見る

AIの限界と不連続性

- なめらかな計算では、判断は表現できない ──AIと不連続性の問題

- なめらかに世界を計算するための数 e と π

- AIは「決めない」ことで賢くなる ―勾配・確率・保留という態度と、決断を急がない設計

- 確率は不確実性を減らすためのものではない ―確率の本当の役割と、「曖昧さを保持する設計」という視点

判断・責任・人間の役割

- 人間はどこに残るのか──Human-in-the-loop の再定義

- Human-in-the-loop が機能しない本当の理由 ―なぜ「最後に人間」は責任を失うのか、Human-as-Author への転換

- AIはなぜ「責任」を持てないのか ――判断と責任が分離できない理由と、ロジック外在化の必然性

- 評価関数は誰の価値観か? ―スコアに埋め込まれる暗黙の判断と、人間が「書かなかった価値」の扱い

最適化・評価・暴走の問題

- 最適化が暴走するとき、何が起きているのか ―目的関数が世界を歪める瞬間と、Goodhartの法則を設計でどう扱うか

- なぜ「説明可能AI」は本質的な説明にならないのか ―Explanation と Justification の違いと、ロジックと説明責任の分業

- 例外は失敗ではない ―例外処理をどう設計に組み込むか、例外が多いほど健全なシステムという視点

常識・信用・社会実装

AIを“産業”として捉え直す視点

- AI工場モデル(AI Factory) ― AIはソフトウェアではなく「製造業」になる ―

- AI品質工学(AI Quality Engineering) — 品質工学が、なぜAIの時代に再び重要になるのか —